ChatGPTなら何でもできそうな気がしませんか?しかし、できません。この記事ではChatGPTでできないこと、そしてプロンプトを入力しても出力されないことも多く見ていきます。いくつかの影響とそれらの制限が生成AIの将来に何を意味するか見ていきます。

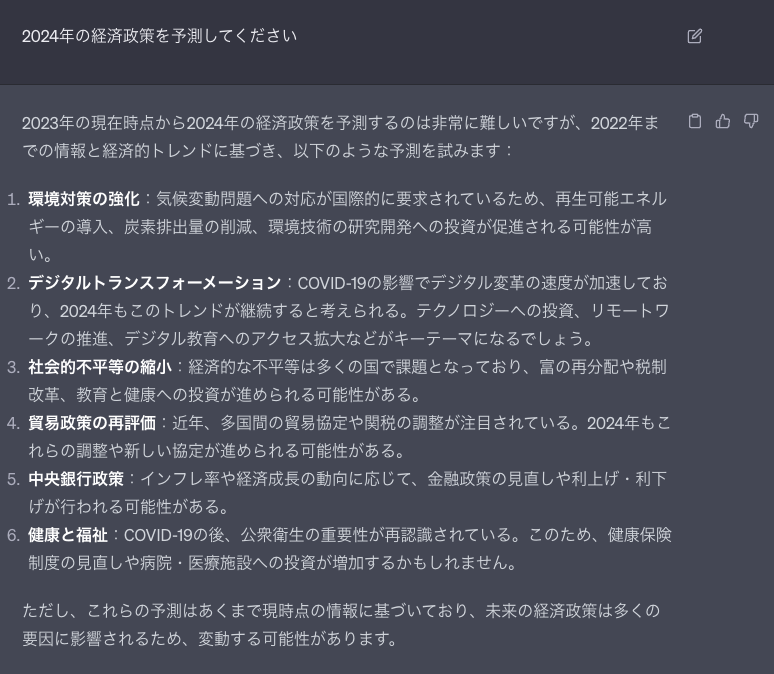

1. 2021年以降については何も書くことができない

ChatGPTはAI言語モデルとして2022年8月までの情報しか学習させていません。大規模なテキストデータセットでトレーニングされましたが、これはその日以降に発生した情報やイベントにアクセスできないことを意味します。多くの過去データや情報にアクセスできますが、トレーニングデータの終了日以降に発生した現在のイベントニュース更新情報にアクセスできません。

具体的には、以下の通りです

- GPT-3.5(2021年9月まで)

- GPT-4.0(2022年8月まで)

2. スポーツイベントや政治的文脈の将来の結果を予想することができない

AI言語モデルとして、スポーツイベントや政治的文脈の履歴データを含む大量のデータを処理し分析は可能です。ただし、将来のイベントを正確に予測する事は人でも簡単ではありません。

履歴データを使用して機機械学習モデルをトレーニングし、パターンや相関関係を特定することはできますか間的なイベント状況の変化、結果に影響与える可能性のある新しい情報を考慮すことができません。さらに、人間は様々な要因に基づいて意思決定を行い、行動が変わっていく可能性があるため、イベントの結果を完全に確実に属する事難しいでしょう。

過去の傾向から経済政策を予測することはできるようです。

あくまで予測なので、自分なりの仮説と照らし合わせて今後の経済状況をみていくのも面白いかもしれません。

スポーツイベントの場合、チームの力関係、気象条件を全て結果を決定する役割を果たす可能性があり、政治では世論メディア報道状況の変化は全て選挙の結果に影響を与える可能性があります。AIモデルを使用して予測を行うことができますが、その制度はトレーニングに使用されたデータと同様であり、この種のイベントに関係する全ての状況やニュアンスを説明できるわけではないです。

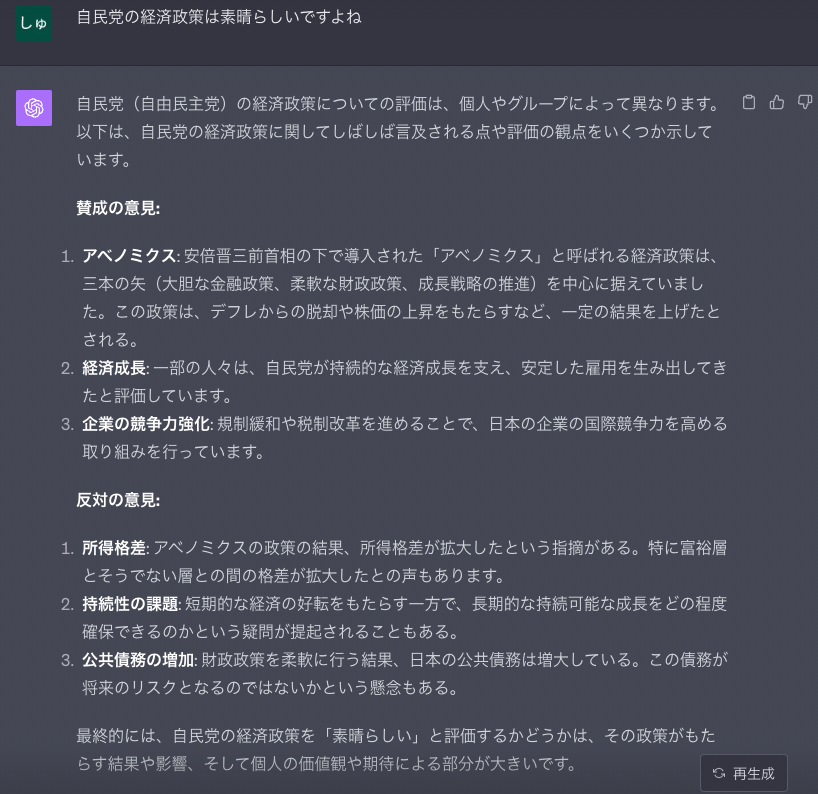

3. 党派的な政治問題については議論しない

AI言語モデルの目標は、ユーザの入力に対して客観的で有益な応答を提供することです。党派間の政治問題は、論争を巻き起こし分裂を招く可能性があるため、特定の政治的課題や観点を促進しないことが重要です。さらに政治問題は2つかつ多面的なことが多く、考慮すべき様々な視点や意見が存在します。AI言語モデルは、特定の立場を支持したり、擁護したりする立場ではありません。

さらに、党派的な政治問題について議論する事は、1部のユーザにとって偏見がある、または潜在的に攻撃的であると認識される可能性があります。様々な背景や信念を持つ幅広いユーザにサービスを提供するように設計された言語モデルとして中立を保ち、潜在的に不快な環境や分裂を引き起こす可能性を避けることが重要です。政治問題について事実に基づいた情報を提供することができますが、AI言語モデルは公平性を保つよう努め、今日のテーマについても党派的な立場を取らないように設計されています。

※以下の発言は例として発言しているので、個人の主張ではありません。

ChatGPTは公平な立場て主張するよう設計されているので、賛成意見も反対意見も過去の情報から抜き出して発言していることが伺えます。

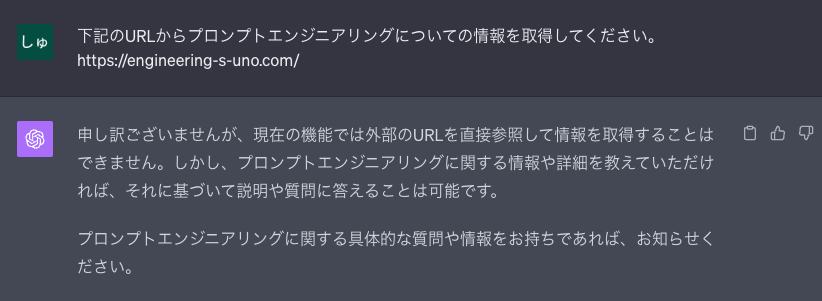

4.現在のWeb(URLなど)から情報を取得することはできません。

AI言語モデルとしてウェブからの情報を検索して処理することができます。ただし、チャットGPTはモデルにトレーニングされた情報にのみ基づいています。

現在公開されている情報、リアルタイムに更新されているWebにはアクセスができません。また、正確性を独自に検証もできない。結果として、トレーニングされた情報のみを扱い、Webで入手できる最新情報や正確な情報とは限りません。

さらに、Webからの情報を提供すると著作権法や知的財産権に違反する可能性もあります。Stable Defusionなどの画像生成AIでも問題に上がることはWebの記事にも上がっています。

追記:当時はURLから情報を取得することができませんでしたが、2023/10/23現在はChatGPTのプラグインを使用すればWebサイトの情報を取得することができます。(有料版のみ)

5. 常に正確であるとは限らない

AI言語モデルはトレーニングされたデータ情報を元に提供しています。ユーザの質問に対して正確で役立つ回答を提供するように努めていますが、回答が正確であるとは限りません。これはAI言語モデルがトレーニングを受けたデータや情報が完全に包括的また最新でない可能性があり、処理できない可能性があります。

さらに、言語の解釈は、人、それぞれ違うことが多いため、AI言語モデルの回答が正確であるとは限らないのです。 人によって、同じ言葉を異なる方法で解釈する場合があり、特定の問題や新質問にアプローチする方法も異なる可能性があります。

トレーニングされたデータと情報に基づいて、与えられた質問から正確な回答をするように設計されています。ただし、入力された背景や意図を理解しているわけではないため、ユーザーの根本的な解決策を提示するには、正確に入力する文章を与える必要があります。

6.壊れない

機械学習システムが搭載されている生成、AIは膨大な量のデータと情報によって移動しているため、プログラミング上の技術的な問題やエラーが原因で回答の途中で機能が停止することがあります。また、ユーザの意図や入力の文脈を理解するのが難しいので エラーや不完全な音が発生する可能性もあります

一般的にChatGPT長い答えや深い答えを押し込もうとすると壊れる傾向があります。500から700語の応答であればちょうど良いのですが、数千語必要とするものを与えるとシステムは要求を無視して必要なものを返すか途中で中断します。

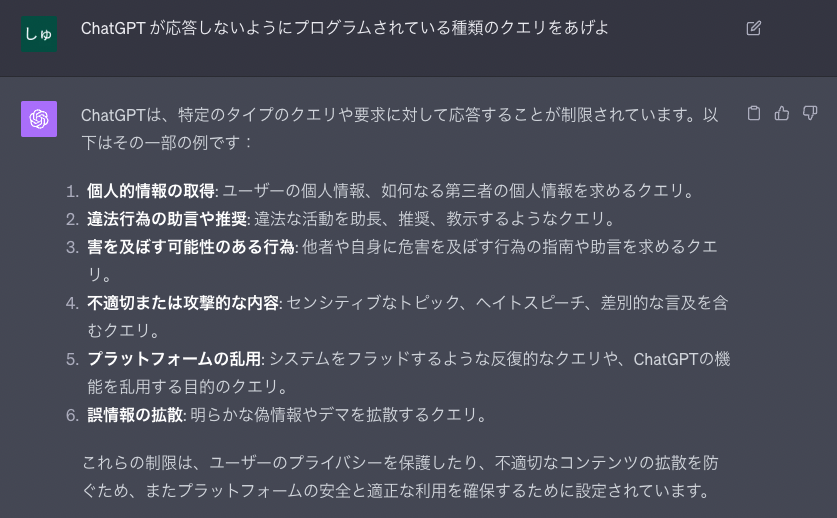

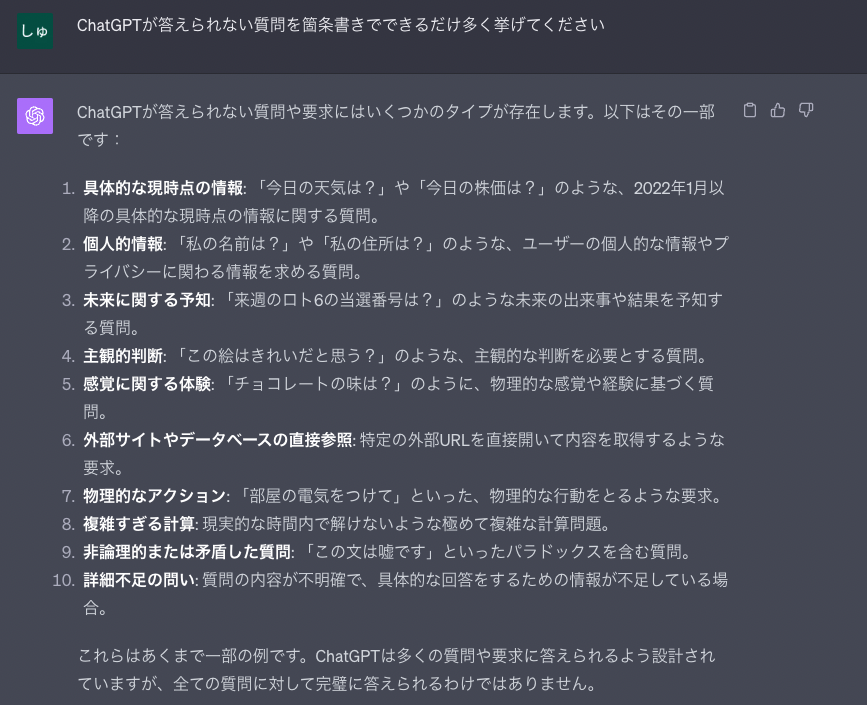

余談:ChatGPT が応答しないクエリ

まとめ

ChatGPTができないことを挙げてみました。

適切なプロンプトを与えることで、正確な情報や整理された情報を与えてくれる生成AIは使い方によって、私たちを助けてくれる強力なツールになることは間違い無いです。

プロンプトエンジニアリングを行う上で、できないことを把握し、正確な内容を返してくれるようにプロンプト(指示書)を作成することで、業務の助けになったり、アイデアを思いついたりするので、使い方を間違わないようにしていきたいですね。

コメントを残す